英特尔用于视频分析的边缘AI计算盒开发简介

一、概述

将多路视频流解码与视频分析集成。利用灵活的AI能力和参考视频分析管道对应用进行端到端配置,以实现快速开发。

用于视频分析的边缘AI计算盒有两种安装脚本——开发和部署,适用于解决方案开发周期的不同阶段。

用于视频分析的边缘AI计算盒可以是连接到摄像头的独立设备,能够实时进行边缘分析。此外,它还可以连接到网络,作为网络上的分散式 AI 服务,按需运行离线深度学习分析。

选择配置和下载来下载以下程序包和软件。

二、配置和下载

代表情景监测的图标。是一个中心有斜三角形的圆圈。圆圈外部有感叹号、圆环和检查标记。

编程语言:Python、C、C++

可用软件:英特尔® 发行版 OpenVINO™ 工具套件 2021.4.2

三、推荐的硬件

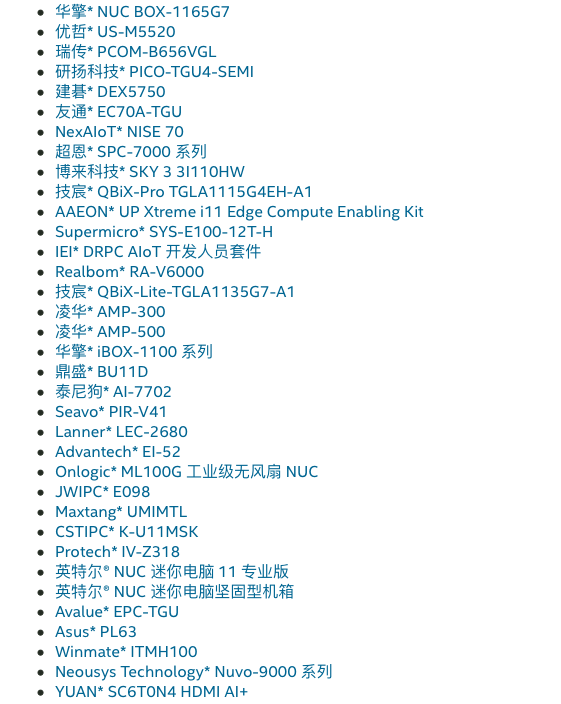

我们建议搭配以下硬件使用此程序包。有关其他建议,请参阅推荐的硬件页面。 (多厂商硬件支持)

四、目标系统要求

第 11 代和第 12 代智能英特尔® 酷睿™ 处理器和赛扬® 处理器

操作系统:

Ubuntu* 20.04(内核版本为 5.8 或更高)

面向第 12 代智能英特尔® 酷睿™ 处理器的 Ubuntu* 20.04 配备内核版本 5.15

至少 128 GB 磁盘空间

至少 8GB (4GB x2) 内存,具有 8GB 交换空间

直接互联网接入

五、工作原理

用于视频分析的边缘AI计算盒为轻便型边缘设备创建了完整的视频分析管道。该程序包针对第 11 代和第 12 代智能英特尔® 酷睿™ 处理器和赛扬® 处理器进行了优化,包含集成显卡,可为 AI 计算加速提供增强性能与效率。

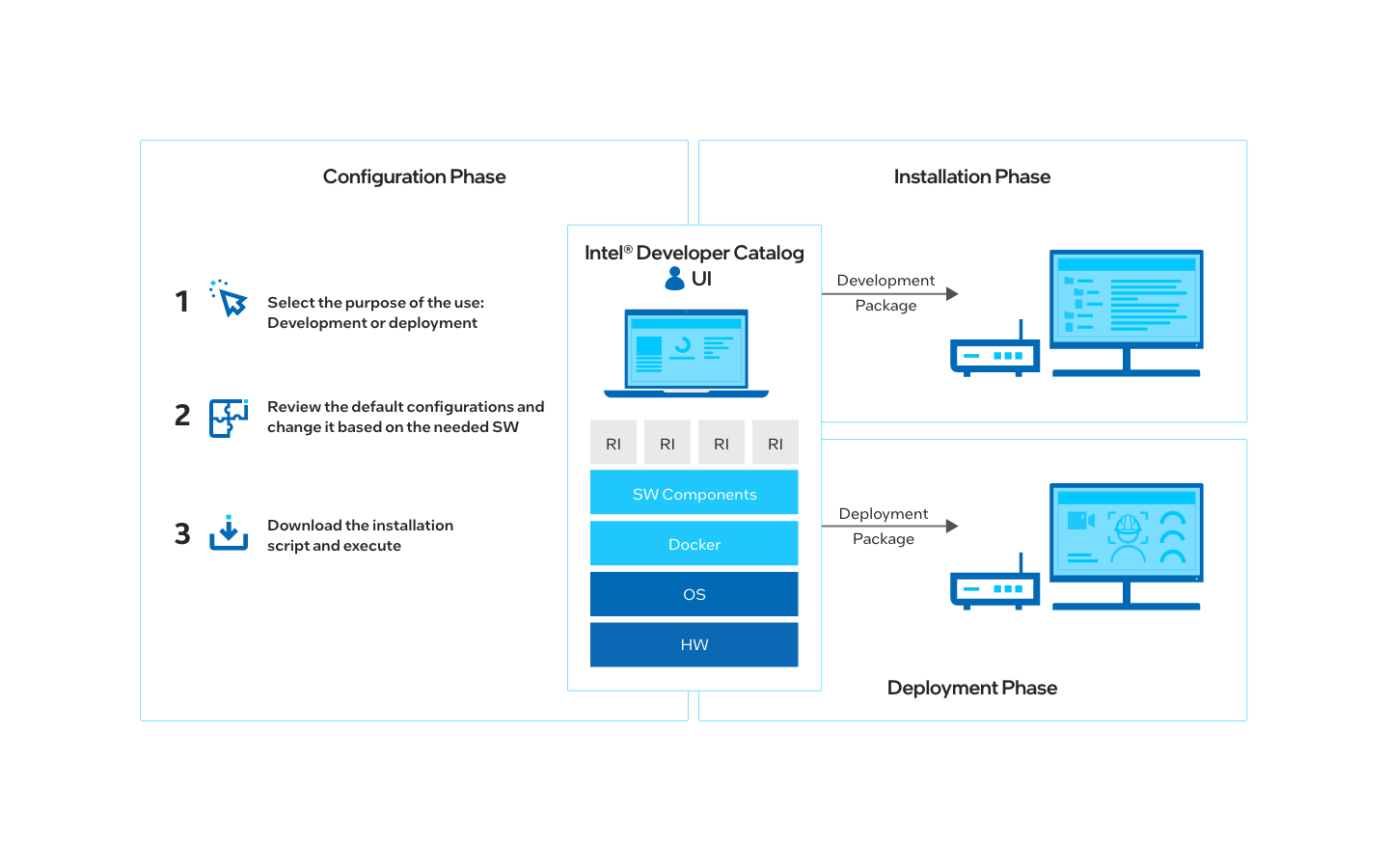

挑选解决方案所需的软件模块并相应地下载安装脚本。在此版本中,提供了不同风格的安装脚本——开发和部署。(参见图 1)

六、开发软件包

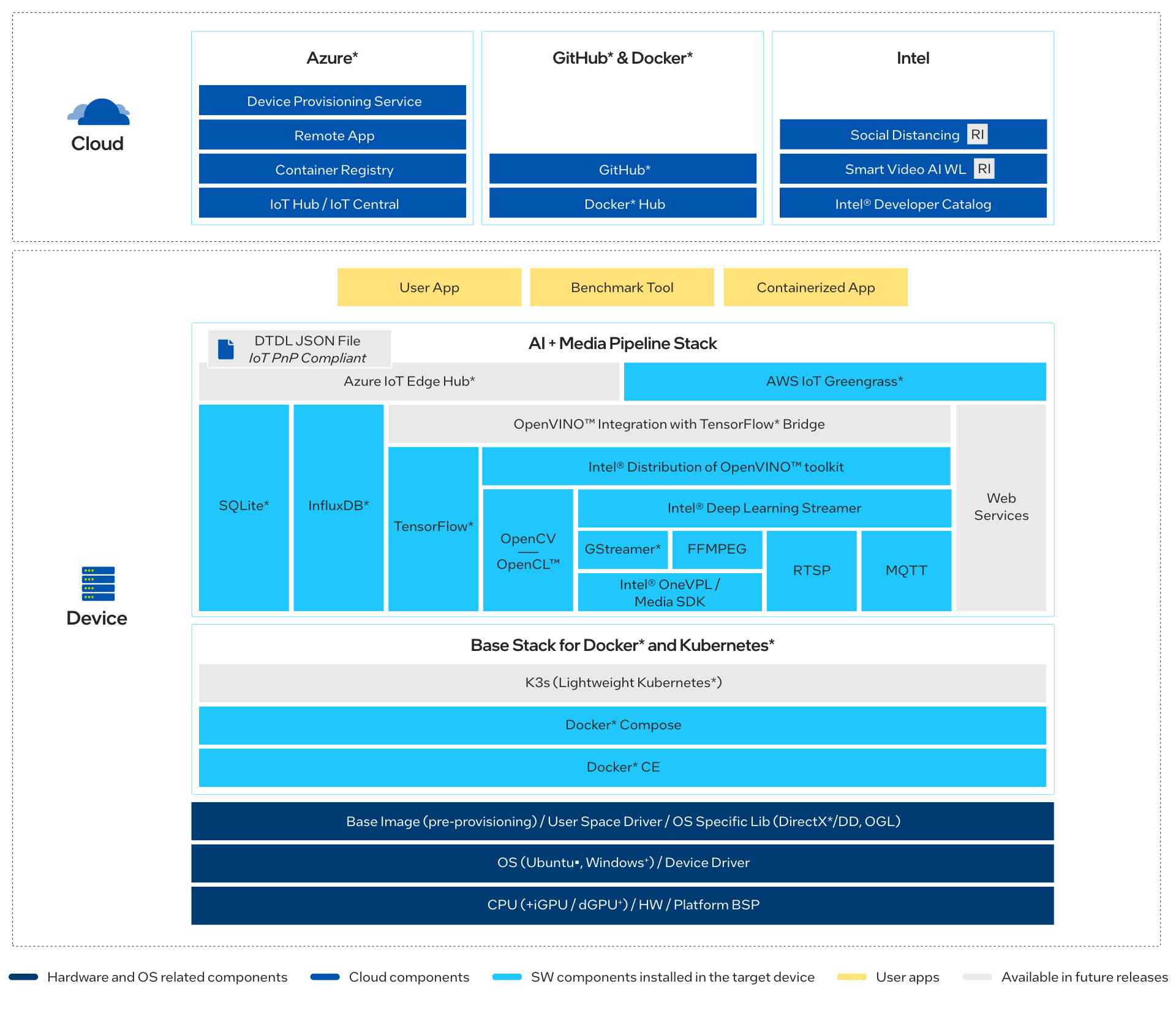

开发版软件包提供了必要的模块(参见图 2):

英特尔® 发行版 OpenVINO™ 工具套件

英特尔® Media SDK

RTSP 服务器

MQTT 服务

TensorFlow 桥

Gstreamer

英特尔® Deep Learning Streamer(英特尔® DL Streamer)

SQLite 数据库*

Docker 社区版 (CE)*

Docker Compose*

其他组件以容器形式提供,例如云服务提供商连接器(Microsoft Azure* 和 AWS*)、InfluxDB* 数据库和容器化 OpenVINO™ 工具套件。开发软件包旨在提供完整的 SDK 或工具套件,让您轻松省力地设置开发环境。

七、部署软件包

部署软件包提供的主要软件与开发软件包相同,但预选的模块主要为运行时库。目标是最大限度减少程序包的安装占用空间,使其适合部署到内存和存储资源可能受限的边缘设备。

图表以方框图形式展现。最左边的模块代表配置阶段,中间则是英特尔 Developer Catalog UI,两个箭头指向右边的两个模块:上面的开发程序包和下面的部署程序包。

图 1:面向视频分析的边缘 AI 计算盒 - 开发和部署。

如图 2 所示,集成 GPU (iGPU) 是部署 AI 工作负载的主要目标平台。CSP 连接器提供了接口,可供边缘 AI 计算盒利用云服务创建边缘到云功能,例如遥测、设备入网和可管理性。此外,我们准备了许多参考实现(例如智能视频 AI 工作负载),它们作为一种快速演示工具,供开发人员用于评估边缘AI计算盒硬件性能。

架构以复杂的方框图表展现。上面的模块从左到右依次是云、Azure* 及其功能的方框、GitHub 和 Docker 的方框,最后是英特尔功能。下面的模块最左边是设备,然后是它右边的多层方框。AI + 介质管道堆栈在面向 Docker 和 Kubernetes 的基础堆栈上方。

图 2:用于视频分析的 AI 计算盒软件堆栈示意图

八、入门

必备条件

系统必须设置根密码。

要使第 12 代英特尔® 酷睿™ 处理器或赛扬® 处理器(原 Alder Lake 产品)与 GPU 加速器协同工作,请完成以下步骤:

sudo vim /etc/default/grub

将 “i915.formorce_probe=*” 附加至 GRUB_CMDLINE_LINUX_DEFAULT: 结尾

GRUB_CMDLINE_LINUX_DEFAULT="quiet splash i915.force_probe=*"

sudo update-grub

sudo reboot

注意:智能视频AI工作负载参考实现也需要这些步骤。

安装程序包

选择配置和下载下载程序包,然后遵循以下步骤安装。

配置和下载

1、打开一个新终端,进入下载的文件夹并解压缩下载的软件包:

unzip edge_ai_box_for_video_analytics.zip

2、转到 edge_ai_box_for_video_analytics/ 目录:

cd edge_ai_box_for_video_analytics

3、更改 edgesoftwar 可执行文件的权限:

chmod 755 edgesoftware

4、运行以下命令,安装程序包:

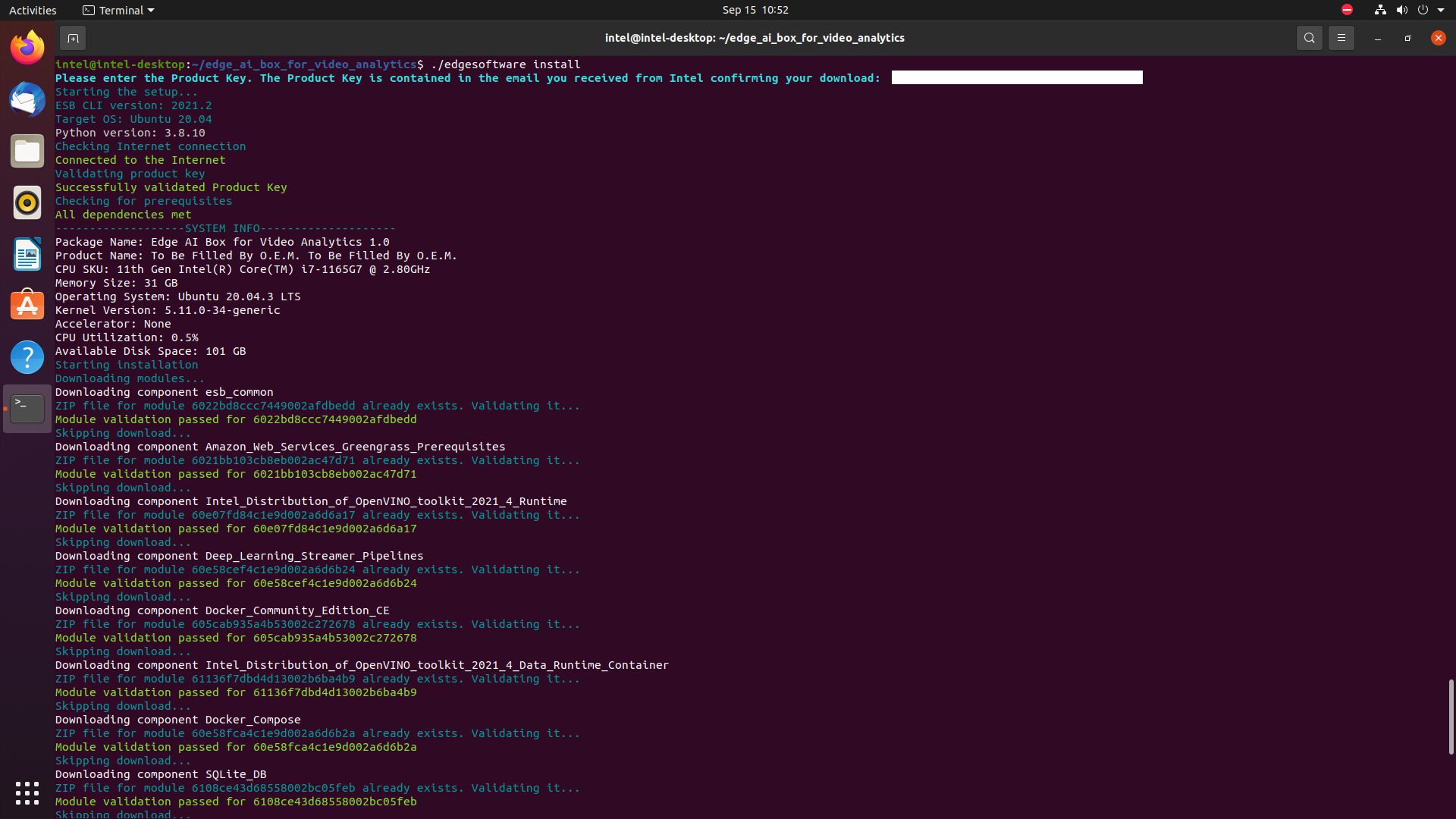

./edgesoftware install

5、在安装过程中,系统会提示您提供产品密钥。产品密钥包含在英特尔向您发送的确认下载的电子邮件中。

控制台窗口显示系统提示输入产品密匙。

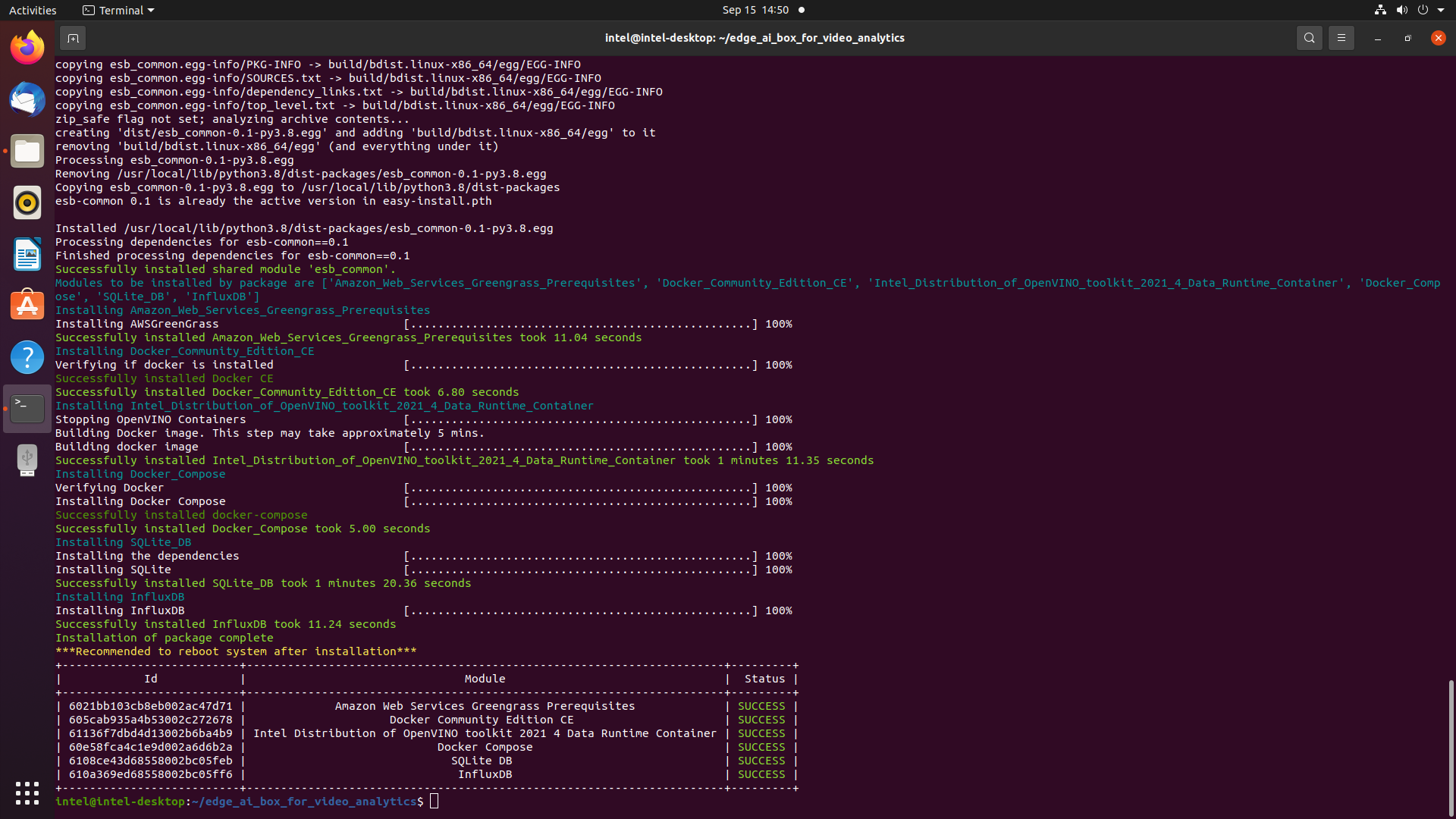

6、安装完成后,您会看到消息 “Installation of package complete”(软件包安装完成)以及每个模块的安装状态。

控制台窗口显示安装期间的系统输出。流程结束后,系统将显示 “Installation of package complete” 和各模块的安装状态。

基于程序包构建解决方案

使用硬件加速的单对象和多对象检测教程应用程序。

另外,了解 OpenVINO™ 与 TensorFlow* 集成示例目录中的演示。

要将 Linux 上运行的物联网即插即用桥接样本连接至 Azure* 物联网中枢,请通过预先安装的 azure_cli、Azure 物联网资源管理器和克隆的存储库运行样本。

九、结论和后续步骤

您使用此应用程序,成功为轻便型边缘设备创建了完整的视频分析管道。

在下一步中,请尝试智能视频 AI 工作负载参考实现。

十、了解更多

要继续学习,请参阅以下指南和软件资源:

英特尔® 发行版 OpenVINO™ 工具套件文档

OpenVINO™ 与 TensorFlow* 集成